今回はiPhoneショートカット以外の話です.

スポンサーリンク

知らずとも浸透してきたAI

OpenAIは一般向けにAPIを公開してはや3年が経ちました.

現在では文章の生成や翻訳などに限らず、また提供する側も増えたことで様々な分野で活躍しています.

とりとめのないやり取りだったり、相談事だったり、仕事だったり、仕事からプライベートまで使い方次第で人々を満足させてくれます.

きっかけ

ちょっと前から「プロンプトエンジニアリング」が広まっています、ようは「生成AIに対して、望む回答を引き出すための文章(プロンプト)の設計技術」のことですね、「最強プロンプト」とか「◯◯式プロンプト」とか謳ってる類のやつです.

その中にはDM内でのやりとりだったり有料Noteだったり、あるいは書籍だったりと、生成AIから知ることができない手法で共有されています.

例えばChatGPT自身に聞いてみると、以下のコンテンツは学習に利用されないため、聞き出すことはできません.

- 著作権で保護されたコンテンツ

- 有料コンテンツなどや、ログインしないと読めない情報

- クローラーで取得できないコンテンツ

- 支払いが必要なもの

- Javascriptで表示される内部コンテンツ

となると、「最強プロンプト!」だの「◯◯式プロンプト」だのといった閉じられたコンテンツはChatGPTなどでは取得できないはずです.

しかしモノによっては核心までガッツリ答えられてしまうことがあります.

なぜこんなことが起こるのか

これもChatGPTとやりとりした結果ではありますが、例えば以下が考えられます.

- 提供側

・宣伝時の「匂わせ」

・コンテンツの一部の無料公開

・ライブ配信やセミナー中の口頭漏洩

・利用規約や注意喚起の不備 - 第三者(主にSNS)

・利用した感想・レビューの投稿

・スクショや転載

・購入者間のやりとり

・又聞き - その他(両者に共通・間接的要因)

・断片情報の積み重ね

・曖昧な情報→推測のヒントに

生成AIにとっては有料コンテンツ自体は規約などによって取得できなくとも、これらの「正規の情報元」の集約によってある程度推測できる場合があります.

配信側も宣伝したいのに内容を一切書かないわけにはいきませんし匂わせすらしないというのは難しいです.

使用者の感想なんかも止めるわけにはいきませんしそもそも不可能です.

本来そういったバラけた情報を集約して推測するのは人間には至難の業、しかしプロンプトとして広めたい肝心の生成AIがそれを実現できてしまう、ある意味皮肉な話です.

当然こういった「バラけたヒント」は有名・人気コンテンツほど多く、結果有料コンテンツとして機能しない可能性が高まります.

AI活用のたぐいはAIを利用するからこそ、その情報やアイデアはAIに取り込まれます.

したがって情報商材が有料だったとしても、誰かが使うことで必然的にそのノウハウはAIを使う全員に還元されるわけです.

配信者の全員がそれを自覚した上で配信してるかは知る由もないですけどね.

実際に利用するユーザーからすればおいしい話ですが、配信側はこのジレンマをどうにかしないといけないわけですね.

現実は頼る人が一定数存在するため廃業にはまだ遠いでしょうが.

逆に言えばこういった性質に気づく人が増えれば増えるほど、情報商材の価値は下がっていきます.

情報屋にとって厄介な「思考誘導型」プロンプト

情報配信を売買する、つまり「情報の独占」が重要な情報屋にとって、こういったバラバラの情報の集約によるAIの推測というのは、独占を妨げ、アイデアの再発明や発展、応用を促すため非常に都合が悪いでしょう.

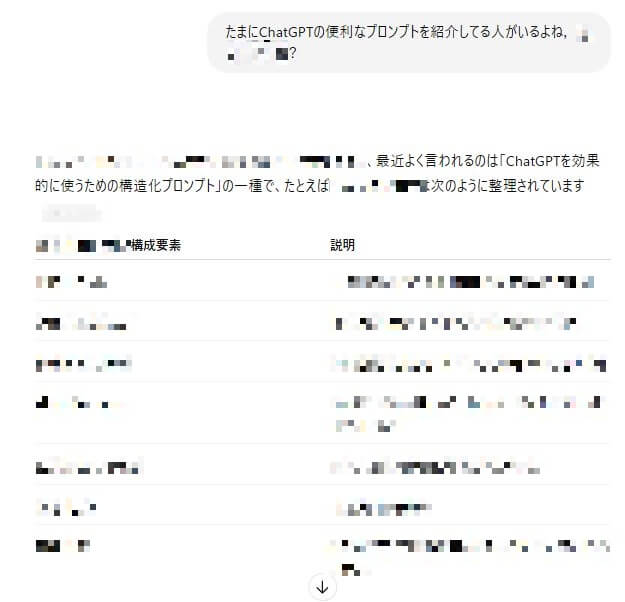

情報屋が好むAIテンプレートのうち構造化テンプレートは、使用目的がある程度限られています.

それはそれで強みではあるんですが、逆に言えばそれは汎用性に劣り状況変化に対応できず、却って時間がかかるリスクを持ち合わせています.

しかし上で書いた通りこれらのテンプレートはAI上で使っている以上AIがテクニックとして既に所有しています.

なので最初から入出力が決まっているなら「◯◯方で出力して」とすればいいですし、わからないなら誘導型を経て「どういう整理法がある?」と教えてもらってから選ぶ選択肢もあるわけです.

ここでプロンプトの活用法を知っている必要はないわけです、それはAIが知っているからですね.

〆

ちなみに最初に貼った画像の場合は、ソースであるNoteにガッツリプロンプトの本質が書かれてるタイプな上有料でない状態でした.

念の為ChatGPTだけでなくCopilotやGeminiでも質問してみたんですが、1~2回の質問であっさり同じソースを見つけ出しました.

AIの便利さを感じたと同時に、反AIになる人の気持がちょっとわかる、そんなお話でした.